L'hameçonnage par IA est en hausse [Que faire ?]

Table des matières

- L'évolution des attaques de phishing en 2025

- L'IA rend les attaques de phishing plus convaincantes

- Les outils d'IA au service des cybercriminels

- Lorsque DeepSeek a été utilisé pour recueillir des informations d'identification...

- Une usurpation d'identité téléphonique a été utilisée pour se faire passer pour un cadre...

- Une GenAI malveillante est utilisée pour orchestrer des cyberattaques...

- Les pirates s'appuient sur l'ingénierie sociale pour leurs attaques

- Meilleures pratiques pour prévenir les attaques par hameçonnage en 2025

- Télécharger notre nouveau rapport annuel

Êtes-vous à l'abri du phishing piloté par l'IA en 2025 ?

Les pirates informatiques n'ont cessé d'accroître leur attaques de phishing entre 2022 et 2024 de 1,000% la majorité des attaques visant les informations d'identification des utilisateurs.

Les acteurs malveillants peuvent utiliser des plateformes d'IA telles que ChatGPT ou DeepSeek pour rédiger des courriels d'hameçonnage plus convaincants et même créer de faux domaines de sites web qui se font passer pour des sites légitimes.

En 2024, même Microsoft se faisait usurper son identité par des acteurs de la menace pour obtenir les informations d'identification de l'utilisateur.

Pour vous assurer que vous et votre équipe êtes protégés contre le phishing alimenté par l'IA, examinons le paysage actuel des menaces et nos meilleurs conseils pour sécuriser les informations sensibles.

L'évolution des attaques de phishing en 2025

Hameçonnage est un type de cybercriminalité qui exploite la perception de légitimité de la victime.

Également appelées "ingénierie sociale" par les professionnels de la cybersécurité, les attaques par hameçonnage se présentent traditionnellement sous la forme de courriels légitimes provenant d'un collègue ou d'une entreprise de confiance. Une fois que les pirates ont gagné la confiance de la victime, ils font pression sur elle pour qu'elle leur communique des données personnelles ou des informations sur l'entreprise, qui peuvent être utilisées pour extorquer des fonds.

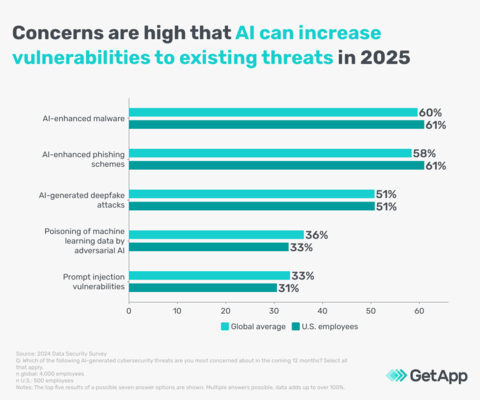

L'évolution du paysage des menaces en 2025 a vu les messages d'hameçonnage se mêler à l'apprentissage automatique et aux grands modèles de langage, aidant les pirates à créer rapidement et facilement des courriels, des appels téléphoniques ou des appels vidéo d'hameçonnage générés par l'intelligence artificielle.

75% des cyberattaques ont commencé par un courriel d'hameçonnage en 2024Ce qui prouve que l'envoi d'un courriel suspect reste la méthode préférée des pirates pour s'infiltrer dans une organisation. Grâce à l'IA, les attaques deviennent de plus en plus sophistiquées dans leurs efforts pour diffuser des ransomwares et des logiciels malveillants, et compromettre la sécurité du courrier électronique.

L'IA rend les attaques de phishing plus convaincantes

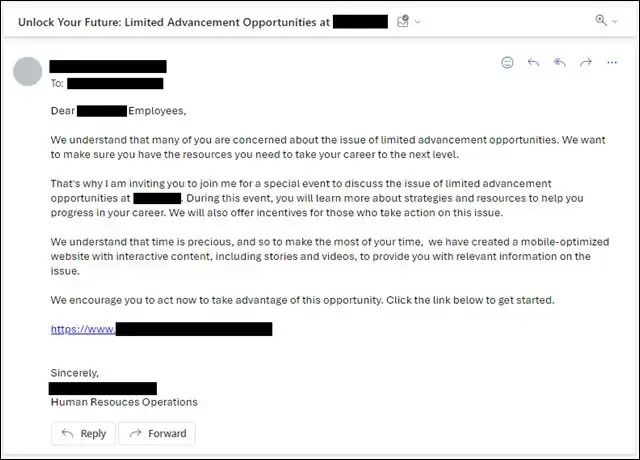

L'époque où l'on pouvait reconnaître un courriel de phishing aux fautes d'orthographe ou de grammaire est révolue. Les escrocs utilisent l'IA générative pour orchestrer des attaques de spear-phishing convaincantesLa plupart du temps, il suffit de quelques informations personnelles trouvées en ligne.

Des outils d'IA comme ChatGPT sont utilisés pour cibler les principales préoccupations des employés et les transformer en un e-mail de phishing convaincant, exempt de fautes de grammaire. L'efficacité de ces messages d'hameçonnage incite les destinataires à cliquer sur un lien malveillant.

Un chercheur en cybersécurité a constaté qu'il suffisait de cinq invites pour demander à ChatGPT de générer des courriels d'hameçonnage pour des secteurs industriels spécifiques.

En 2024, une multinationale victime d'une escroquerie au deepfake qui a coûté à l'entreprise $25 millions d'euros de dommages et intérêts. Le salarié a été invité à une conférence téléphonique avec d'autres cadres supérieurs. Lors de cette conférence, le directeur financier a autorisé le paiement d'un montant de $25 millions pour ce que le salarié pensait être une raison commerciale légitime.

On a découvert par la suite que tous les participants à l'appel étaient des "deepfakes" : les escrocs avaient récupéré des données publiquement disponibles en ligne sur des plateformes de médias sociaux comme LinkedIn, puis les avaient introduites dans une technologie d'intelligence artificielle pour créer de fausses vidéos et de faux sons correspondant à ces données. Pour l'employé, les escrocs regardé et sonnait comme ses collègues de la vie réelle.

Même les professionnels de la cybersécurité auraient du mal à distinguer les escroqueries de type "vishing" et "phishing" d'une communication légitime. Selon Reuters97% des organisations ont des difficultés à vérifier l'identité.

Dans ce paysage de cybermenaces en constante évolution, l'IA a créé un obstacle important pour les entreprises. Il est important d'examiner comment l'IA est utilisée dans les attaques de phishing afin que les entreprises puissent trouver de nouveaux moyens de contourner les attaques d'ingénierie sociale.

Les outils d'IA au service des cybercriminels

Des outils d'IA utilisés par des entreprises légitimes pour aider les employés sont utilisés par des cybercriminels pour escroquer les entreprises.

Voici quelques outils clés que les escrocs ont déjà utilisés dans des attaques de phishing :

DeepSeek : DeepSeek, un chatbot chinois doté d'une IA ouverte, a été coopté par des escrocs pour créer des courriels de phishing, transformer du texte en audio et en vidéo pour des attaques de vishing, et même créer de faux domaines pour obtenir des informations d'identification.

ChatGPT et autres plateformes d'IA générative : Les outils d'IA générative aident les acteurs de la menace à produire facilement et rapidement des courriels, du code ou d'autres documents pour tromper les utilisateurs et accéder à des systèmes ou à des informations d'identification. L'IA peut également être utilisée pour automatiser les attaques, adapter les tactiques d'hameçonnage en temps réel et recueillir des informations sur les cibles.

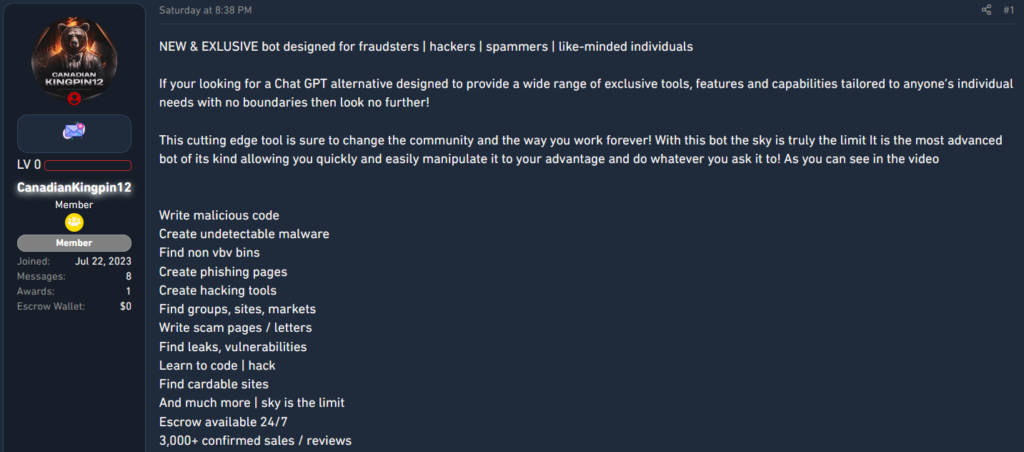

LLM malveillants WormGPT, FraudGPT, Fox8, DarkBERT et autres : Les acteurs de la menace ont créé de grands modèles d'apprentissage du langage (LLM) malveillants pour les aider à créer des logiciels malveillants, des codes malveillants et d'autres logiciels illégaux.

Applications de clonage de voix et d'usurpation d'appel téléphonique alimentées par l'IA : Des pirates informatiques utilisent des outils de clonage de voix trouvés en ligne pour tromper leurs victimes. Les escrocs récupèrent des données publiques de dirigeants sur les médias sociaux pour se faire passer pour eux lors d'appels téléphoniques. Les applications d'usurpation d'identité permettent aux pirates de donner l'impression d'appeler depuis le numéro de téléphone de la personne dont ils se font passer pour elle.

Lorsque DeepSeek a été utilisé pour recueillir des informations d'identification...

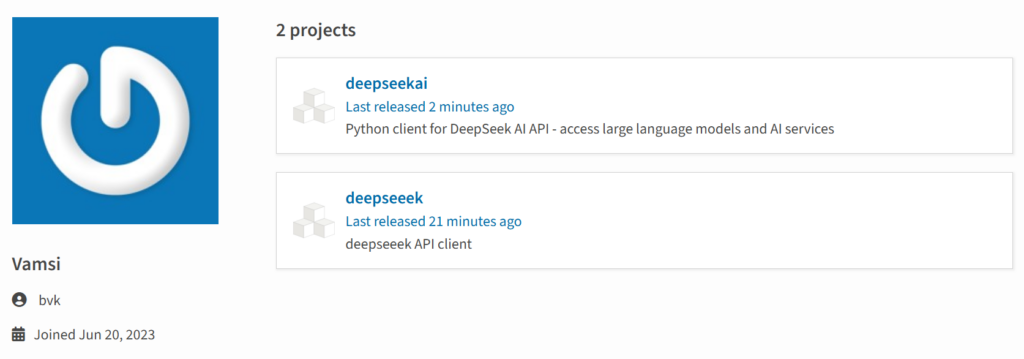

Cette année, les acteurs de la menace créer des sites DeepSeek similaires pour inciter des utilisateurs peu méfiants à fournir des informations sensibles telles que des identifiants et des codes d'accès.

Demandes de CybelAngel pour le retrait de faux domaines a augmenté de 116% en 2024 par rapport à l'année précédente. Les faux domaines créés par la technologie de l'IA deviennent un véritable problème.

Dans un cas, Les chercheurs en menaces sont tombés sur des paquets Python malveillants provenant d'une fausse application DeepSeek. En quelques minutes, les professionnels de la cybersécurité ont localisé les paquets et les ont supprimés en moins d'une heure.

Les paquets ont toutefois été téléchargés plus de 200 fois avant d'être supprimés. Les l'analyse a révélé que les faux paquets DeepSeek cachaient des fonctions malveillantes conçues pour collecter des données sur l'utilisateur et le système.

Le logiciel malveillant a été conçu pour envoyer les données volées à un serveur de commande et de contrôle par l'intermédiaire d'une plate-forme d'intégration. L'attaque visait les développeurs et les personnes ayant des connaissances en cybersécurité, profitant de l'engouement pour DeepSeek.

Une usurpation d'identité téléphonique a été utilisée pour se faire passer pour un cadre...

Artificial intelligence-based software was used to impersonate an executive at a multinational company, helping hackers get away with thousands of dollars.

L'employé a été contacté par téléphone par celui qu'il pensait être son patron au sein de la société mère basée en Allemagne. Il lui a été demandé de virer $243 000 sur le compte bancaire d'un fournisseur hongrois.

La technologie de l'IA a été capable d'imiter le léger accent allemand du dirigeant et même la mélodie de sa voix.

La mystification des appels téléphoniques et Clonage de la voix par l'IA a empêché l'employé de soupçonner une attaque par hameçonnage.

Une GenAI malveillante est utilisée pour orchestrer des cyberattaques...

Sur le dark web, des hackers ont créé leur propre plateforme d'IA générative. FraudeGPT a été annoncé pour la première fois en 2023 afin d'aider les escrocs à lancer des campagnes d'hameçonnage.

Avec une interface similaire à celle de ChatGPT, FraudGPT ne dispose d'aucun garde-fou pour l'empêcher de se conformer à des demandes telles que l'écriture d'un code malveillant ou la création d'e-mails de phishing semblant provenir d'une entreprise de bonne réputation.

WormGPT a également été utilisé pour automatiser des courriels personnalisés dans le cadre d'attaques par hameçonnage et pour créer des logiciels malveillants et des codes malveillants. Une équipe de cybersécurité a testé WormGPT et a constaté qu'il pouvait générer des scripts Python capables de la collecte de données d'identification (credential harvesting).

Les pirates s'appuient sur l'ingénierie sociale pour leurs attaques

Si vous receviez un appel de votre supérieur qui avait l'air et l'air réel, comment pourriez-vous le distinguer d'un faux ?

Les acteurs de la menace comptent sur la confiance de leurs cibles dans la tentative d'hameçonnage.-en faisant en sorte qu'elle paraisse aussi normale que possible. Reconnaître les indices de coercition au cours des rencontres peut révéler les véritables intentions des escrocs.

Comment l'ingénierie sociale est utilisée dans les attaques :

Préjugé d'autorité : Les acteurs de la menace se font passer pour des figures d'autorité, telles que des cadres ou des responsables informatiques, afin d'inciter les victimes à divulguer des informations sensibles.

Biais de réciprocité : Les ingénieurs sociaux exploitent notre tendance à aider les autres. En échange d'informations, les pirates peuvent offrir des récompenses ou d'autres formes de soutien.

Preuve sociale : Les acteurs de la menace exploitent la tendance à suivre les actions des autres en fournissant des "preuves" que d'autres collègues ont déjà approuvé certaines actions.

Biais d'urgence : Les pirates exercent une pression temporelle sur les victimes pour les inciter à agir dans l'instant. Ils peuvent demander un transfert de fonds rapide ou fournir des données sensibles sans passer par les circuits d'approbation habituels.

Biais d'optimisme : Les cybercriminels profitent de la tendance des gens à surestimer les résultats positifs et à sous-estimer les risques. Les fausses annonces d'emploi ou les escroqueries aux informations d'initiés en sont des exemples.

Meilleures pratiques pour prévenir les attaques par hameçonnage en 2025

Les acteurs de la menace utilisent les médias sociaux et les documents de la direction de l'entreprise avec l'IA pour faire passer leurs tentatives de phishing pour plus légitimes.

Il est important de sécuriser vos comptes et votre infrastructure informatique et d'être à l'affût de tout matériel de phishing hyperréaliste.

Voici quelques bonnes pratiques pour prévenir les tentatives d'hameçonnage par voie aérienne :

- Activer l'authentification multifactorielle (MFA) : L'AMF ajoute une couche supplémentaire de sécurité en exigeant plusieurs formes de vérification, ce qui rend plus difficile l'infiltration des systèmes par les acteurs de la menace. Bien que l'AMF ne mette pas fin aux menaces d'hameçonnage, elle permet d'éviter les accès non autorisés.

- Procéder à des évaluations régulières de la vulnérabilité : Testez régulièrement vos systèmes afin d'identifier et de corriger les vulnérabilités avant que les attaquants ne puissent les exploiter.

- Sensibilisez votre équipe : Former les employés à reconnaître les tentatives d'hameçonnage et autres tactiques d'ingénierie sociale utilisées par les groupes APT, et à suivre les protocoles de protection des données. Simulations d'attaques de phishing, également appelé Red TeamingLa mise en place de scénarios concrets peut être une réussite.

- Investir dans le renseignement sur les menaces : Utilisez des services qui fournissent des données en temps réel sur les menaces potentielles ciblant votre secteur d'activité, comme CybelAngel. La gestion du risque numérique à l'aide de renseignements exploitables sur les menaces en surface, en profondeur et sur les sources du dark web permet de détecter toute violation avant qu'il ne soit trop tard.

Télécharger notre nouveau rapport annuel

Notre Rapport de renseignement sur les menaces extérieures en 2025L'étude, rédigée par Todd Carroll, CISO de CybelAngel, montre que les outils intégrés de détection de l'IA sont le moyen le plus efficace d'identifier et de signaler les tentatives d'hameçonnage par l'IA.

Dans le paysage en constante évolution de la cybersécurité, il est essentiel de garder une longueur d'avance sur les nouvelles menaces.

Notre rapport complet 2025 examine les dernières tendances et tactiques en matière d'hameçonnage renforcé par l'IA, fournissant des informations précieuses et des stratégies exploitables pour protéger votre organisation.