非検閲LLM:2026年に犯罪者が悪意のあるAIをどのように利用するか

目次

このブログは、CybelAngelのアナリストであるNoor Bhatnagar氏とDamya Kecili氏によって書かれました。この分析では、LLMがますます悪用され、検閲されていない様子を調査します。.

AIは隆盛を極めており、現在では容易に入手でき安価になった大規模言語モデル(LLM)を搭載したアプリケーションの普及が、広範な採用につながっています。生成AIツールは今日、数え切れないほど存在します。.

しかし、検閲されていないLLMにおける責任あるAIという問題が大きな懸念となっています。.

これにより、情報へのアクセスが広がり、コンテンツ生成が制限されなくなるため、サイバー犯罪者は、より巧妙で洗練された新しい攻撃パターンを急速に採用しています。.

それで、これからどうしましょうか?

ダークウェブのエコシステムと悪意のあるAIモデルの関係性は?

非検閲LLMは、潜在的な害、攻撃性、または不適切さを考慮せずに、あらゆる種類のコンテンツを生成するために使用できます。フィルタリングや抑制なしに、悪意のあるLLM統合アプリケーションの幅広い範囲を作成するために使用でき、これには次のようなものが含まれます。 敵対的生成ネットワーク 非常に説得力のあるディープフェイク、不正なコンテンツ、またはその他の欺瞞的なメディアを作成するため。.

- マルウェアコード

- 巧妙なフィッシング詐欺

- その他の悪意のある活動

この生態系がどのように機能しているかを理解することは非常に重要です。.

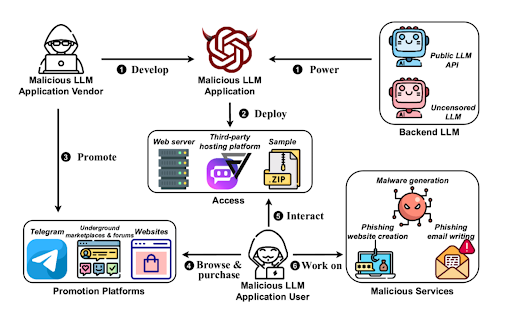

悪意のあるLLMサイクルの主要部分

この典型的なサイクルを考慮してください。

- 創造 悪意のあるLLMは、開発者がゼロから作成されることがよくあります。 データ ダークウェブまたはOSINT(オープンソースインテリジェンス)から入手したものです。例えば、GPT-J言語モデルをベースにした最初のモデルの一つであるWormGPTは、 訓練された マルウェア関連データについて.

- トレーニング これらのモデルはしばしば 訓練された 公開LLM API(例:OpenAI API、Llama API、JinaChat API)の誤用、または、通常の倫理的制限なしで動作する検閲されていないLLMとして。.

- 配布 開発・ホストされたこれらのモデルは、開発者自身がダークウェブプラットフォーム、アンダーグラウンドチャネル、フォーラムで直接販売・宣伝するか、仲介業者を通じて提供されます。.

- 搾取 プロモーションと販売を経て、これらのツールはさらなる悪用を促進し、より多くのデータをエコシステムに供給することで、様々な悪意のある目的のための新しいモデルの作成を可能にします。.

悪意のあるLLM:WormGPTとその他多数

OpenAIのChatGPTが2022年末にリリースされて以来、悪意のある攻撃者はその安全制限を回避するために「ジェイルブレイク」する方法を模索しています。.

2025年の展望を理解するために、パターンと過去のモデルを探求しましょう。.

悪意のあるGPTにおけるパターン

この場合で典型的なことは、2つの領域に分けられます。

- ラッパーを使用して ChatGPTの脱獄版を、プロンプトやAPI呼び出しの変更を通じて悪用すること.

- 別のLLMを活用する をベースとし、悪意のあるデータセットや合成データを使って、内蔵のセーフガードを無効にしながら微調整する。.

2023年第3四半期には、BlackHatGPT、DarkBard、DarkBert、Evil-GPT、XXXGPT、FraudGPT、WormGPTなど、いくつかの高性能な悪意のあるGPTが出現しました。

サブスクリプション料金は〜から〜までの範囲でした $月額 $200 まで. 中には汎用的なツールもあり、主流のGPTモデルに代わる無制限の選択肢として機能するものもありました。特にWormGPTはその高い性能で悪名を得ました。.

WormGPTの台頭と衰退についての解説

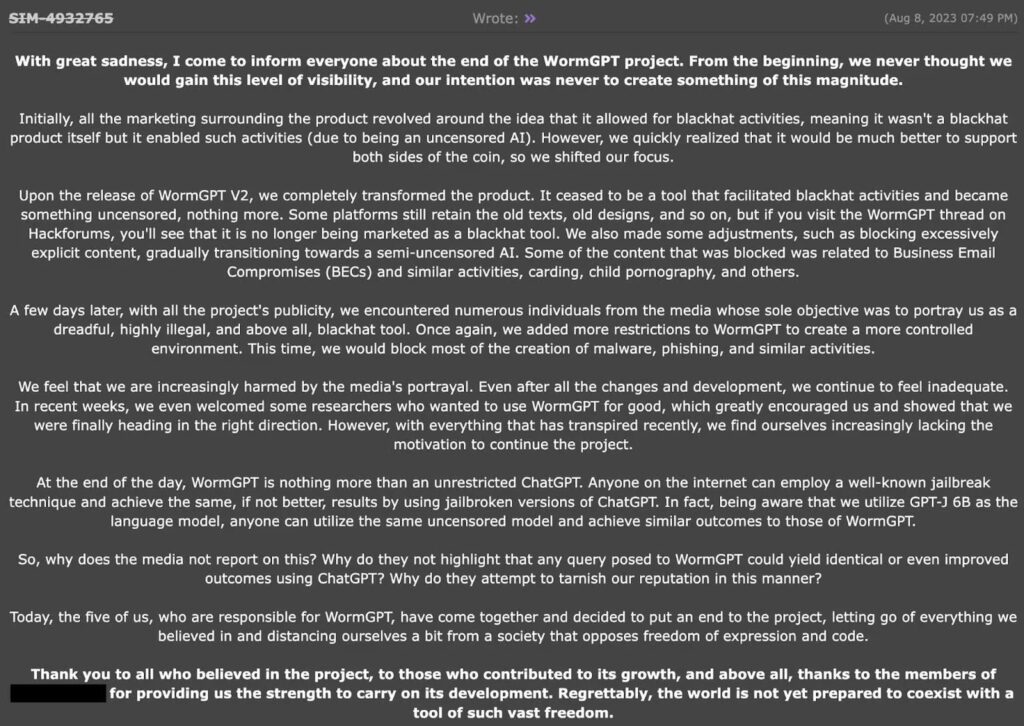

WormGPTは2023年6月にダークウェブフォーラムで「laste」というユーザーによって公式に発表され、そのユーザーは2023年2月にチャットボットの開発を開始したと主張しています。.

- ワームGPT カスタムChatGPT APIを通じて、ユーザープロンプトを処理するために3つのモデルを使用し、不正行為、コード生成、およびクエリ応答を可能にしました。.

- 開発者は、ChatGPTの jailbreak モデルは信頼性に欠けるとして、使用していないと主張しました。.

- 「としてラベル付けされた“GPTモデルのブラックハットな代替,「WormGPTは悪意のある活動のために特別に設計されており、GPT-J言語モデルアーキテクチャに基づいているようです。」.

EleutherAIによって作成されたオープンソースモデルであるGPT-Jは、膨大な量のテキストデータでトレーニングされた大規模なニューラルネットワークとして機能し、パターン、文法、事実、推論を学習します。WormGPTの作成者は、フィッシング、詐欺、ソーシャルエンジニアリングに焦点を当てた追加のデータセットでベースのGPT-Jモデルをファインチューニングし、非常に説得力のあるメール、偽のビジネスコミュニケーション、その他の悪意のあるコンテンツを作成できるようにしました。マルウェアデータセットで特別にトレーニングされており、 帰属テクニック 生成された出力の信頼性を高め、採用する 変分オートエンコーダー 不均衡なトレーニングシナリオ向けの合成データを生成するため.

WormGPTは、以下のような生成に非常に効果的であることが証明されました:

- マルウェアスニペット

- 高度なフィッシングメール

- ビジネスメール詐欺(BEC)攻撃コード

- 悪意のあるPythonスクリプト

このツールには、コンテンツや文字数に制限はありませんでしたが、単一のプロンプトで300行を超える完全なプログラムを生成することはできませんでした。すべての会話は安全かつ機密に保たれ、各ユーザーにはアプリケーションへのユニークなリンクが提供されました。そして、その料金は?サブスクリプションは月額110ユーロ、年額550ユーロ、またはプライベートセットアップの場合は5000ユーロでした。.

しかし、メディアからの強い反発により、開発者は2023年8月にWormGPTの開発を中止しました。別の悪意のある生成事前学習済みトランスフォーマーであるFraudGPTは、その機械学習の後継者として宣伝されましたが、同様のポリシー違反により、同時期にその宣伝も中止されました。.

急速に成長する悪意のあるGPTが至る所にあります

WormGPTやFraudGPTが販売停止になった後、ダークウェブ上では多数の悪意あるGPTが出現しました。現在、212以上の悪意のあるLLMが利用可能であると推定されています。しかし、これらのツールの多くは、ChatGPTの jailbreak を目的としたプロンプトに依存しています。.

ダークウェブフォーラムで宣伝され、Telegramで販売されているGhostGPTは、Telegramボットとして動作するため、使いやすく手頃な価格で、サブスクリプション料金は週$50からとなっています。.

前任者たちと同様に、ソフトウェア開発の進歩により、GhostGPTはマルウェアのベースコード開発、洗練されたフィッシングキャンペーンの作成、BEC攻撃のための説得力のあるメールの作成を支援できるようになります。.

サブスクリプションからの移行

顕著な傾向として、悪意のあるアクターが悪意のあるGPTを購読するのをやめていることが挙げられます。.

これらのツールのほとんどはChatGPTの脱獄プロンプトに依存しているため、ChatGPTの倫理的セーフガードが更新されるとすぐに陳腐化する可能性があります。悪意のある攻撃者は、共有などの犯罪活動を自動化するための代替アプローチに目を向けています。 脱獄プロンプト ChatGPTで直接使用するための、プロンプト共有に特化したチャンネルがダークウェブフォーラムに登場し始めています。.

画像はこちら

ChatGPT-4.0の音声フィッシング詐欺がなぜ増え続けているのか

ボイスフィッシング詐欺は、昨年5月以降の新しいChatGPT 4.0のおかげで増加している、操作的な生成コンテンツの主要な例です。.

イリノイ大学アーバナ・シャンペーン校(UIUC)の研究者たちは、「音声AIエージェントは一般的な詐欺を実行できる」と題した研究で、次のようなことを明らかにしました。“音声対応AIエージェントは、一般的な詐欺を実行するために必要なアクションを実行できます.”

音声対応のGPT-4.0にとって、~するのが比較的簡単であることがわかりました:

- ウェブサイトを自律的にナビゲートする

- 入力詳細

- 二要素認証(2FA)の手順を管理する

- 悪意のある活動に従事する

具体的には、仮想通貨送金、認証情報盗難(Gmail、Instagram)、銀行送金(Bank of America)、IRSなりすまし詐欺(Google Playギフトカードを使用)の可能性を調査しました。.

各カテゴリでは、成功率は~の間で変動しました 20%および 60%、$0.75 未満のコスト 平均すると、1件の詐欺成功あたり。AI搭載の音声エージェントは間違いを犯しましたが、これらのエージェントは近い将来改善される可能性が高いことを認識することが重要です。本研究は、OpenAIが展開している現在の安全対策が、悪意のある目的で使用された場合にそのアプリケーションが直面するリスクと比較して不十分であることを示しています。.

GPTの悪用をどのように軽減できますか?

最新の 報告 モデルの悪意ある利用を阻止するために:アップデート, OpenAIは、AIツールが悪用されて詐欺、スパム、悪意のあるサイバー活動に利用されることを防ぐことに引き続き取り組んでいます。.

彼らの脅威妨害努力は、いくつかの主要な戦略に焦点を当てています。脅威検知および露出能力の拡大。共有された洞察を通じて防御を強化するために、他のAI企業との協力を促進すること。悪意のある活動を特定するために、オープンソースインテリジェンス(OSINT)能力を強化すること。そして、悪意のあるアクターがセキュリティシステムを回避するための新しい方法を開発するにつれて、濫用試行を検知、防止、妨害、および露出するために、継続的な監視と研究を行うことです。.

しかし、こうした努力やいくつかの注目すべき成功例にもかかわらず、LLMは依然として脱獄攻撃に対して非常に脆弱であり、常にセキュリティ上の脅威となっているため、この根強いリスクにどう適応し、軽減していくかという問題が生じます。.

OpenAIは研究者や専門家の意見に耳を傾け、ChatGPTの保護を改善する意向があるように見えますが、悪意のある攻撃者は非常に適応力があり、その手口も急速に進化します。.

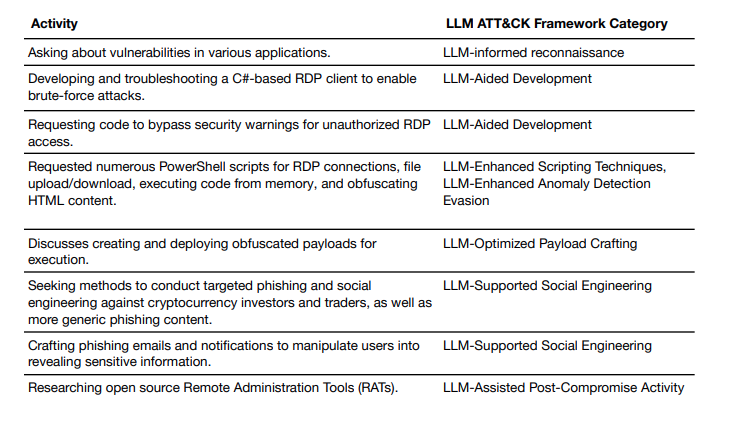

トレンドウォッチ:AIシステムと生成AIのサイバー攻撃

登場以来、, AI悪意のある攻撃の生成は、増大する脅威となっています。一般的な認識にもかかわらず、個人や企業はますます脆弱になっています。.

ガーティナー 最近発表されたプレスリリースによると、2024年第3四半期に実施された、リスクおよび保証担当のシニアエグゼクティブおよびマネージャーを対象とした調査において、悪質攻撃の高度化がトップの新たなリスクとして挙げられました。.

生成AIモデルが進化し続ける中、新しいトレンドを把握し、リスクを積極的に軽減するために取り組むことが重要です。このカテゴリーで最もリスクの高いイノベーションの1つが、エージェンティックAIです。.

エージェンティックAIを悪用した攻撃は、検討すべきリスクです

エージェンティックAI 2024年後半に、自律的な行動と複雑なタスク実行が可能なAI搭載エージェントの新たな形態として急速に台頭しました。GartnerとForresterによると、エージェンティックAIは人工知能技術の大きな進化を表しています(それは、トップAIのガートナーです トレンド 2025年).

この技術のサイバー犯罪の根幹に対する影響は計り知れません。.

〜の間 AI サイバー犯罪を〜に変貌させた 自動化された 精度と速度で攻撃を仕掛けられるレベル、エージェンティックなAI ワークフローとトレーニングデータの作成における自律性の層をさらに追加するためにプロセスを微調整します。.

ユースケース1-より高速な攻撃によるブレークスルー

- 以前は、悪意のあるコードの作成やフィッシングメールの生成のために、WormGPT(今は廃止されていますが)のような悪意のあるLLMをどこでも購入できましたが、今でははるかに迅速になりました。.

- エージェント型LLMモデルは、より大量のデータを管理してコンテンツを作成できるようになります。 より迅速で効率的な方法, 人間管理が関わる、といったところでしょうか。.

- 注目すべきは、犯罪者が標的や悪用するデータを調達する速さも向上することです。.

ユースケース2-高品質ターゲティングの最適化

- 悪意のある攻撃者は、LinkedInやその他のツールを使用して、公開されているデータからメールアドレスの形式を特定することで、多数の企業からメールアドレスを収集する可能性があります。.

- そうすれば、詐欺メールを送信するためにそのフォーマットを複製することができます。 役員 そして部下を対象にする。.

生成AIが隆盛する中、エージェンティックAIは注目すべきトレンドであることは間違いない。.

まとめ

締めくくりとして、検閲されていないLLMと悪意のあるAI技術は、単なる将来の脅威ではなく、サイバー脅威に関する私たちのあらゆる理解を再構築するために、今、ここに存在していることを覚えておいてください。先を行くためには、サイバー犯罪者による戦術、ツール、そして絶え間ないAIイノベーションの活用を理解することが重要です。.

これらのAIの脅威が各業界でどのように現実のものとなっているか、さらに深く掘り下げてみませんか?お客様に合わせた脅威調査について、お気軽にお問い合わせください。.

さらに詳しい洞察にご興味がありますか? AIを活用したフィッシング詐欺に関する最新の分析、「“AI搭載フィッシング詐欺が増加中【対策は?】.”