Uncensored LLMs: How Criminals Use Malicious AI in 2026

Table des matières

- Quel est le lien entre l'écosystème du dark web et les modèles d'IA malveillants ?

- Principales étapes du cycle malveillant de la maîtrise de l'éducation et de la formation tout au long de la vie

- LLM malveillants : WormGPT et bien plus encore

- Modèles de construction de GPT malveillants

- Une explication sur l'ascension et la chute de WormGPT

- Les TPG malveillants en pleine expansion sont omniprésents

- S'affranchir des abonnements

- Pourquoi les escroqueries par phishing vocal ChatGPT-4.0 sont-elles de plus en plus fréquentes ?

- Comment limiter l'utilisation abusive des TPG ?

- Observation des tendances : Systèmes d'IA et cyberattaques de l'IA générique

- Les attaques par IA agentique sont un risque à prendre en compte

- Cas d'utilisation 1- Une percée avec des attaques plus rapides

- Cas d'utilisation 2- Optimisation du ciblage de haute qualité

- Conclusion

Ce blog a été rédigé par les analystes de CybelAngel, Noor Bhatnagar et Damya Kecili. Cette analyse porte sur la manière dont les LLM sont de plus en plus exploités et non censurés.

L'IA est en plein essor et la prolifération d'applications alimentées par de grands modèles de langage (LLM), désormais facilement accessibles et abordables, a conduit à une adoption généralisée. Les outils d'IA générative se comptent sur les doigts de la main aujourd'hui.

Pourtant, la question d'une IA responsable au milieu de LLM non censurés se pose avec acuité.

Dans ce blog, nous examinerons les tendances qui ont ouvert la voie à des applications malveillantes de transformateurs génératifs pré-entraînés (GPT). Nous examinerons également comment certains LLM non censurés manquent d'importantes restrictions de sécurité, et ce que cela signifie pour votre organisation en temps réel.

Comme cela permet un accès plus large à l'information et une production de contenu sans restriction, les cybercriminels adoptent rapidement de nouveaux schémas d'attaque, plus élaborés et plus sophistiqués.

Alors, quelle est la suite des événements ?

Quel est le lien entre l'écosystème du dark web et les modèles d'IA malveillants ?

Un LLM non censuré peut être utilisé pour générer n'importe quel type de contenu sans tenir compte du potentiel de nuisance, d'offense ou d'inadéquation. Sans filtrage ni suppression, il peut être utilisé pour créer une large gamme d'applications malveillantes intégrées au LLM, y compris celles qui exploitent les éléments suivants les réseaux adversaires génératifs (GAN) pour produire des "deepfakes" très convaincants, des contenus frauduleux ou d'autres supports trompeurs.

- Code des logiciels malveillants

- Escroqueries par hameçonnage sophistiquées

- Autres activités malveillantes

Il est essentiel de comprendre le fonctionnement de cet écosystème.

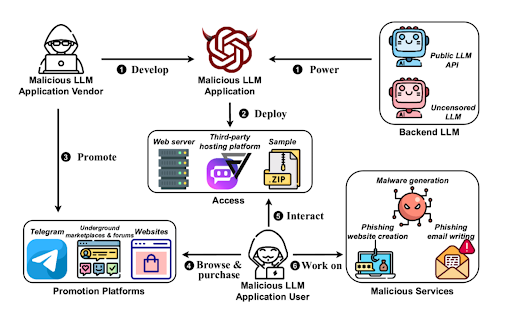

Principales étapes du cycle malveillant de la maîtrise de l'éducation et de la formation tout au long de la vie

Prenons l'exemple d'un cycle typique :

- Création : Les LLM malveillants sont souvent créés par des développeurs à partir de zéro en utilisant des données provenant du dark web ou de l'OSINT (Open Source Intelligence). Par exemple, WormGPT, l'un des premiers modèles de ce type basé sur le modèle de langage GPT-J, aurait été formés sur les données relatives aux logiciels malveillants.

- Formation : Ces modèles sont souvent formés en utilisant soit une mauvaise utilisation des API LLM publiques (par exemple, OpenAI API, Llama API, JinaChat API), soit des LLM non censurés, fonctionnant sans les restrictions éthiques habituelles.

- Distribution : Une fois développés et hébergés, ces modèles sont vendus et promus directement par les développeurs sur des plateformes du dark web, des canaux souterrains et des forums, ou par le biais d'intermédiaires.

- Exploitation : Après la promotion et la vente, ces outils facilitent d'autres exploitations, en alimentant l'écosystème avec davantage de données et en permettant la création de nouveaux modèles à diverses fins malveillantes.

LLM malveillants : WormGPT et bien plus encore

Depuis le lancement de ChatGPT par OpenAI à la fin de l'année 2022, des acteurs malveillants ont exploré les moyens de "jailbreaker" la plateforme afin de contourner ses restrictions en matière de sécurité.

Explorons les tendances et les modèles précédents pour comprendre ce qui nous attend en 2025.

Modèles de construction de GPT malveillants

Ce qui est typique dans ce cas peut être divisé en deux domaines :

- Utilisation d'un wrapper d'exploiter une version jailbreakée de ChatGPT en modifiant les invites ou les appels API.

- Tirer parti d'un autre LLM comme base et l'affiner avec des ensembles de données malveillantes et des données synthétiques tout en désactivant les protections intégrées.

Au troisième trimestre 2023, plusieurs GPT malveillants très performants sont apparus, notamment BlackHatGPT, DarkBard, DarkBert, Evil-GPT, XXXGPT, FraudGPT et WormGPT. S

Les prix des abonnements varient de $10 à $200 par mois. Certains étaient des outils spécialisés, tandis que d'autres servaient d'alternatives non restreintes aux modèles GPT classiques. WormGPT, en particulier, s'est fait connaître pour ses performances élevées.

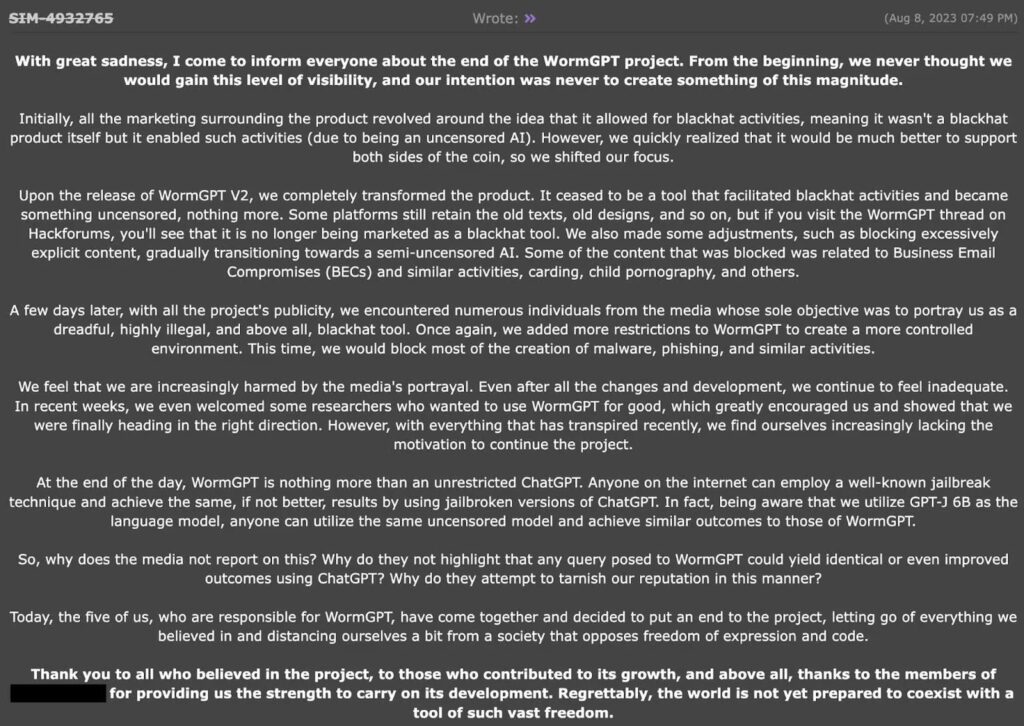

Une explication sur l'ascension et la chute de WormGPT

WormGPT a été officiellement présenté en juin 2023 sur les forums du dark web par un utilisateur nommé "laste", qui a affirmé avoir commencé à développer le chatbot en février 2023.

- WormGPT a utilisé trois modèles pour traiter les demandes des utilisateurs, permettant des activités illégales, la génération de codes et des réponses aux requêtes par le biais d'une API ChatGPT personnalisée.

- Le développeur a déclaré ne pas avoir utilisé le modèle de jailbreak ChatGPT, invoquant son manque de fiabilité.

- Étiqueté comme "Alternative noire aux modèles GPTWormGPT a été spécialement conçu pour des activités malveillantes et semble être basé sur l'architecture du modèle de langage GPT-J.

GPT-J, un modèle open-source créé par EleutherAI, fonctionne comme un grand réseau neuronal entraîné sur des quantités massives de données textuelles, apprenant les modèles, la grammaire, les faits et le raisonnement. Les créateurs de WormGPT ont affiné le modèle GPT-J de base avec des ensembles de données supplémentaires axés sur le phishing, la fraude et l'ingénierie sociale, ce qui lui permet de créer des courriels très persuasifs, de fausses communications commerciales et d'autres contenus malveillants. Il a été spécifiquement formé sur des ensembles de données de logiciels malveillants, en s'appuyant sur les éléments suivants les techniques d'attribution renforcer la crédibilité des résultats générés et utiliser les résultats de la recherche. autoencodeurs variationnels (VAE) pour générer des données synthétiques pour des scénarios de formation déséquilibrés.

WormGPT s'est avéré très efficace pour générer :

- Extraits de logiciels malveillants

- Courriels d'hameçonnage sophistiqués

- Codes de l'attaque Business Email Compromise (BEC)

- Scripts Python malveillants

L'outil n'avait pas de limites concernant le contenu ou le nombre de caractères, bien qu'il ne puisse pas générer des programmes complets dépassant 300 lignes de code avec une seule invite. Toutes les conversations étaient sécurisées et confidentielles, chaque utilisateur recevant un lien unique vers l'application. Quels sont les frais d'utilisation ? L'abonnement s'élevait à 110 euros par mois, 550 euros par an ou 5 000 euros pour une installation privée.

Cependant, les réactions négatives des médias ont conduit le créateur à mettre fin à WormGPT en août 2023. FraudGPT, un autre transformateur génératif pré-entraîné malveillant, a été présenté comme son successeur en matière d'apprentissage automatique, mais sa promotion a cessé à peu près au même moment en raison de violations similaires de la politique.

Les TPG malveillants en pleine expansion sont omniprésents

Depuis l'abandon de WormGPT et FraudGPT, de nombreux GPT malveillants sont apparus sur le dark web. On estime que plus de 212 GPT malveillants sont actuellement disponibles. Cependant, nombre de ces outils s'appuient sur des invites conçues pour jailbreaker ChatGPT.

GhostGPT, annoncé sur des forums du dark web et vendu via Telegram, fonctionne comme un bot Telegram, ce qui le rend convivial et abordable, avec des prix d'abonnement commençant à $50 par semaine.

Comme ses prédécesseurs, GhostGPT peut contribuer au développement du code de base des logiciels malveillants, à l'élaboration de campagnes d'hameçonnage sophistiquées et à la composition de courriels convaincants pour les attaques de type BEC.

S'affranchir des abonnements

Une tendance notable s'est dégagée : les acteurs malveillants renoncent à s'abonner à des TPG malveillants.

Comme la plupart de ces outils s'appuient sur les invites de jailbreak de ChatGPT, ils peuvent rapidement devenir obsolètes au fur et à mesure que les protections éthiques de ChatGPT sont mises à jour. Les acteurs malveillants se tournent désormais vers d'autres approches pour automatiser des activités criminelles telles que le partage d'informations. invites de jailbreak pour une utilisation directe avec ChatGPT. Les forums du dark web ont commencé à héberger des canaux dédiés à l'échange d'astuces et de techniques pour de telles invites.

IMAGE ICI

Pourquoi les escroqueries par phishing vocal ChatGPT-4.0 sont-elles de plus en plus fréquentes ?

Les escroqueries par hameçonnage vocal sont un exemple clé de contenu généré manipulateur qui augmente grâce au nouveau Chat GPT-4.0 depuis le mois de mai de l'année dernière.

Des chercheurs de l'université de l'Illinois Urbana-Champaign (UIUC) ont révélé dans leur étude intitulée Voice-enabled AI agents can perform common scams (Des agents d'IA à commande vocale peuvent réaliser des escroqueries courantes) que "des agents d'intelligence artificielle à commande vocale peuvent effectuer les actions nécessaires à l'exécution d'escroqueries courantes."

Ils ont constaté qu'il était assez facile pour la GPT-4.0 à commande vocale d'utiliser la technologie GPT-4.0 :

- Naviguer de manière autonome sur les sites web

- Données d'entrée

- Gérer les procédures d'authentification à deux facteurs (2FA)

- Se livrer à des activités malveillantes

Plus précisément, ils ont examiné la possibilité d'effectuer des transferts de crypto-monnaie, des vols d'identifiants (Gmail et Instagram), des transferts bancaires (Bank of America) et des escroqueries à l'usurpation d'identité auprès du fisc (en utilisant des cartes-cadeaux Google Play).

Pour chaque catégorie, leur taux de réussite se situe entre 20% et 60%, coût inférieur à $0,75 en moyenne par escroquerie réussie. Bien que les agents vocaux dotés d'IA aient commis des erreurs, il est important de reconnaître que ces agents sont susceptibles de s'améliorer dans un avenir proche. Cette étude démontre que les mesures de protection actuellement déployées par l'OpenAI sont insuffisantes par rapport aux risques auxquels ses applications sont exposées lorsqu'elles sont utilisées à des fins malveillantes.

Comment limiter l'utilisation abusive des TPG ?

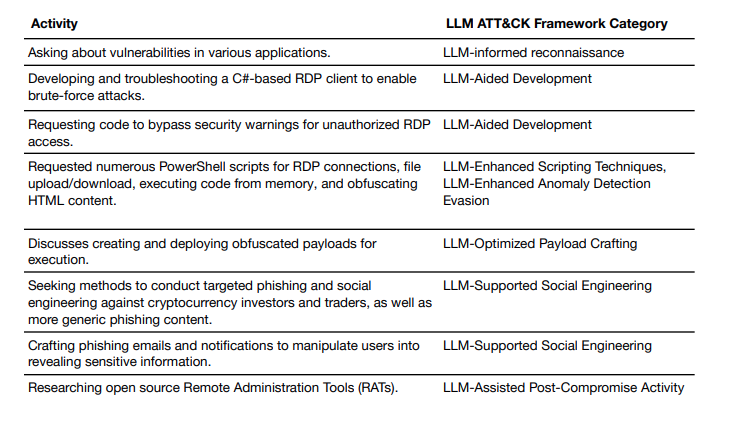

Comme indiqué dans son dernier rapport Perturber les utilisations malveillantes de nos modèles : Mise à jourL'OpenAI reste déterminée à empêcher l'utilisation abusive d'outils d'IA à des fins d'escroquerie, de spam et d'activités cybernétiques malveillantes.

Leurs efforts de perturbation des menaces se concentrent sur plusieurs stratégies clés : développer les capacités de détection et d'exposition des menaces ; encourager la collaboration avec d'autres entreprises d'IA pour renforcer les défenses grâce à des informations partagées ; améliorer les capacités de renseignement sur les sources ouvertes (OSINT) pour identifier les activités malveillantes ; et mener en permanence des activités de surveillance et de recherche pour détecter, prévenir, perturber et exposer les tentatives d'abus à mesure que les acteurs malveillants développent de nouvelles méthodes pour contourner les systèmes de sécurité.

Toutefois, malgré ces efforts et quelques exemples notables de cas réussis, les LLM restent très vulnérables aux attaques de type "jailbreak", ce qui en fait une menace constante pour la sécurité et soulève la question de savoir comment s'adapter à ce risque persistant et l'atténuer.

Bien que l'OpenAI semble être à l'écoute des avis des chercheurs et des professionnels et souhaite améliorer la protection du ChatGPT, les acteurs malveillants sont très adaptables et leurs techniques évoluent rapidement.

Observation des tendances : Systèmes d'IA et cyberattaques de l'IA générique

Depuis leur apparition, AI-Les attaques malveillantes générées par l'Internet constituent une menace croissante. Malgré la prise de conscience générale, les particuliers et les entreprises sont de plus en plus vulnérables.

Gartner a récemment diffusé un communiqué de presse indiquant que les attaques malveillantes renforcées ont été classées comme le principal risque émergent dans une enquête menée auprès des cadres supérieurs et des gestionnaires de risques et d'assurance au cours du troisième trimestre de 2024.

Alors que les modèles d'IA générative continuent d'évoluer, il est crucial de rester informé des nouvelles tendances et de travailler activement à l'atténuation des risques. L'une des innovations les plus risquées dans cette catégorie est l'IA agentique.

Les attaques par IA agentique sont un risque à prendre en compte

IA agentique est apparue rapidement à la fin de 2024 comme une nouvelle itération d'agents alimentés par l'IA, capables d'agir de manière autonome et d'exécuter des tâches complexes. Selon Gartner et Forrester, l'IA agentique représente une évolution significative de la technologie de l'intelligence artificielle (C'est une IA de premier plan selon Gartner tendance pour 2025).

Les implications de cette technologie sont énormes pour les fondements de la cybercriminalité.

Tandis que AI a transformé la cybercriminalité en automatisé à un degré tel que les attaques peuvent se produire avec précision et rapidité, les attaques agen-AI affine les processus pour ajouter un niveau supplémentaire d'autonomie dans la création de flux de travail et de données de formation.

Cas d'utilisation 1- Une percée avec des attaques plus rapides

- Alors qu'auparavant vous pouviez acheter l'un des LLM malveillants, par exemple WormGPT (qui n'est plus utilisé) pour écrire du code malveillant ou générer des courriels d'hameçonnage, c'est désormais beaucoup plus rapide.

- Un modèle Agentic-LLM serait en mesure de gérer la création de contenu susmentionnée pour de plus grandes quantités de données dans un système de gestion de l'information. un moyen plus rapide et plus efficaceIl s'agit d'une question de gestion des ressources humaines.

- Il améliore également la rapidité avec laquelle les criminels peuvent trouver des cibles et des données à exploiter.

Cas d'utilisation 2- Optimisation du ciblage de haute qualité

- Des acteurs malveillants pourraient recueillir les adresses électroniques d'un grand nombre d'entreprises en utilisant LinkedIn ou d'autres outils, afin de déterminer le format de l'adresse électronique à partir de données accessibles au public.

- Ils peuvent ensuite reproduire le format pour envoyer des courriels frauduleux semblant provenir de cadres et de cibler leurs subordonnés.

Il ne fait aucun doute que l'IA agentique est une tendance à suivre, à l'heure où l'intelligence artificielle générative est en plein essor.

Conclusion

En conclusion, n'oubliez pas que les LLM non censurés et les technologies d'IA malveillantes ne sont pas seulement une menace future - ils sont là, maintenant, et remodèlent tout ce que nous savons sur les cybermenaces. Pour garder une longueur d'avance, il faut comprendre les tactiques, les outils et l'utilisation incessante de l'innovation en matière d'IA par les cybercriminels.

Vous souhaitez approfondir la manière dont ces menaces liées à l'IA se matérialisent dans les différents secteurs d'activité ? Contactez-nous pour une enquête personnalisée sur les menaces.

Envie d'en savoir plus ? Consultez notre récente analyse sur les attaques de phishing alimentées par l'IA, "L'hameçonnage par l'IA est en hausse [Que faire ?]."