نماذج لغوية غير خاضعة للرقابة: كيف يستخدم المجرمون الذكاء الاصطناعي الخبيث في عام 2026

جدول المحتويات

كتب هذا المقال مديري تحليلات CybelAngel، نور بهاتناغار و داميا كيسيلي. يتناول هذا التحليل كيف يتم استغلال نماذج اللغات الكبيرة (LLMs) بشكل متزايد وغير خاضع للرقابة.

يشهد الذكاء الاصطناعي ازدهارًا، وقد أدى انتشار التطبيقات المدعومة بنماذج اللغة الكبيرة (LLMs)، التي أصبحت متاحة بأسعار معقولة وسهلة الوصول إليها، إلى تبني واسع النطاق. أدوات الذكاء الاصطناعي التوليدي وفيرة للغاية اليوم.

ومع ذلك، فإن مسألة الذكاء الاصطناعي المسؤول في ظل نماذج لغوية كبيرة غير خاضعة للرقابة تلوح في الأفق.

بما أن هذا يسمح بوصول أوسع إلى المعلومات وإنشاء المحتوى غير المقيد، يتبنى مجرمو الإنترنت بسرعة أنماط هجوم أحدث وأكثر إتقانًا وتطورًا.

إذن، إلى أين نتجه من هنا؟

تتضمن الصلة بين النظام البيئي للويب المظلم ونماذج الذكاء الاصطناعي الضارة ما يلي: * **وفرة البيانات الضارة:** يحتوي الويب المظلم على كمية هائلة من البيانات التي يمكن استخدامها لتدريب نماذج الذكاء الاصطناعي الضارة. يمكن أن تشمل هذه البيانات معلومات مسروقة، وبيانات مخدوشة من مواقع الويب، وأنظمة الاتصالات المخترقة. * **أدوات تطوير الذكاء الاصطناعي الضارة:** غالبًا ما يتم إنشاء ومشاركة الأدوات التي تسهل تطوير نماذج الذكاء الاصطناعي الضارة، مثل برامج التشغيل الآلي والهياكل، على الويب المظلم. * **الأسواق لخدمات الذكاء الاصطناعي الضارة:** توجد أسواق على الويب المظلم تبيع خدمات الذكاء الاصطناعي الضارة، مثل البرامج الضارة التي تم إنشاؤها بواسطة الذكاء الاصطناعي، وهجمات التصيد الاحتيالي، وأدوات التلاعب بالرأي العام. * **التعاون بين الجهات الفاعلة الضارة:** يوفر الويب المظلم منصة للجهات الفاعلة الضارة، بما في ذلك مجرمي الإنترنت، والجهات الفاعلة التي ترعاها الدولة، والمجموعات الإرهابية، للتعاون في تطوير ونشر نماذج الذكاء الاصطناعي الضارة. * **التخفي والقدرة على التكيف:** تتيح طبيعة الويب المظلم لمطوري الذكاء الاصطناعي الضارة ومستخدميه العمل بشكل مجهول، مما يجعل من الصعب على سلطات إنفاذ القانون تحديدهم والقبض عليهم. كما تتيح لهم هذه البيئة تطوير واستخدام نماذج ذكاء اصطناعي تتكيف باستمرار مع الدفاعات الأمنية. بشكل عام، يوفر الويب المظلم بيئة حاضنة لمجرمي الإنترنت لإنشاء وتوزيع نماذج الذكاء الاصطناعي الضارة، مما يمثل تهديدًا متزايدًا للأفراد والمؤسسات والحكومات.

يمكن استخدام نماذج اللغة الكبيرة غير الخاضعة للرقابة لتوليد أي نوع من المحتوى بغض النظر عن الضرر المحتمل أو الجارح أو غير المناسب. بدون تصفية أو قمع، يمكن استخدامه لإنشاء مجموعة واسعة من التطبيقات الضارة المتكاملة مع نماذج اللغة الكبيرة، بما في ذلك تلك التي تستفيد من شبكات الخصومة التوليدية (GANs) لإنتاج صور مزيفة عميقة مقنعة للغاية، أو محتوى احتيالي، أو وسائط خادعة أخرى.

- شيفرة برمجية خبيثة

- عمليات احتيال تصيدية متطورة

- أنشطة خبيثة أخرى

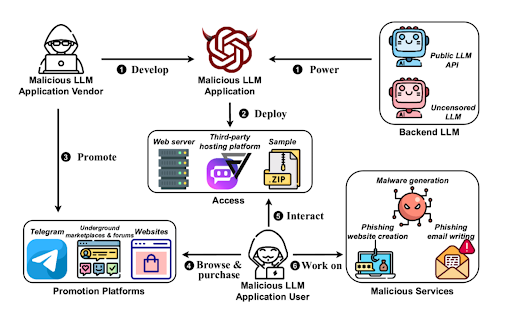

فهم كيفية عمل هذا النظام البيئي أمر بالغ الأهمية.

الأجزاء الرئيسية لدورة نماذج اللغة الكبيرة الضارة

ضع في اعتبارك هذه الدورة النموذجية:

- إبداع غالباً ما يتم إنشاء نماذج لغوية خبيثة بواسطة مطورين من الصفر باستخدام بيانات مصدرها الشبكة المظلمة أو من خلال OSINT (الاستخبارات مفتوحة المصدر). على سبيل المثال، يُعتقد أن WormGPT، وهو أحد النماذج الأولى من هذا النوع القائم على نموذج لغة GPT-J، هو مُدرَّب حول البيانات المتعلقة بالبرامج الضارة.

- تدريب غالبًا ما تكون هذه النماذج مُدرَّب باستخدام إما إساءة استخدام واجهات برمجة تطبيقات نماذج اللغة الكبيرة العامة (مثل واجهة برمجة تطبيقات OpenAI، واجهة برمجة تطبيقات Llama، واجهة برمجة تطبيقات JinaChat) أو كنماذج لغوية كبيرة غير خاضعة للرقابة، تعمل بدون قيود أخلاقية نموذجية.

- التوزيع: بمجرد تطويرها واستضافتها، يتم بيع هذه النماذج والترويج لها مباشرة من قبل المطورين على منصات الويب المظلم، والقنوات السرية، والمنتديات، أو من خلال وسطاء.

- استغلال بعد الترويج والمبيعات، تسهل هذه الأدوات استغلالات إضافية، مما يغذي النظام البيئي بمزيد من البيانات ويمكّن من إنشاء نماذج جديدة لأغراض خبيثة متنوعة.

نماذج اللغة الخبيثة: WormGPT وأكثر من ذلك بكثير

منذ إطلاق ChatGPT بواسطة OpenAI في أواخر عام 2022، يستكشف الجهات الفاعلة الخبيثة طرقًا لـ “كسر حماية” المنصة لتجاوز قيود السلامة الخاصة بها.

دعنا نستكشف الأنماط والنماذج السابقة لفهم ما يكمن أمامنا في عام 2025.

أنماط في بناء نماذج GPT خبيثة

ما هو معتاد في هذه الحالة يمكن تقسيمه إلى مجالين:

- باستخدام مغلف لاستغلال نسخة محسوبة من ChatGPT من خلال موجهات معدلة أو استدعاءات API.

- الاستفادة من نموذج لغوي كبير آخر كقاعدة و ضبطه بدقة باستخدام مجموعات بيانات ضارة وبيانات اصطناعية مع تعطيل أي ضمانات مدمجة.

في الربع الثالث من عام 2023، ظهرت العديد من نماذج GPT الخبيثة عالية الأداء، بما في ذلك BlackHatGPT و DarkBard و DarkBert و Evil-GPT و XXXGPT و FraudGPT و WormGPT.

تتراوح أسعار الاشتراك من $10 إلى $200 شهريًا. كان بعضها أدوات متخصصة، بينما كان بعضها الآخر بمثابة بدائل غير مقيدة لنماذج GPT السائدة. اكتسبت WormGPT، على وجه الخصوص، سمعة سيئة بسبب أدائها العالي.

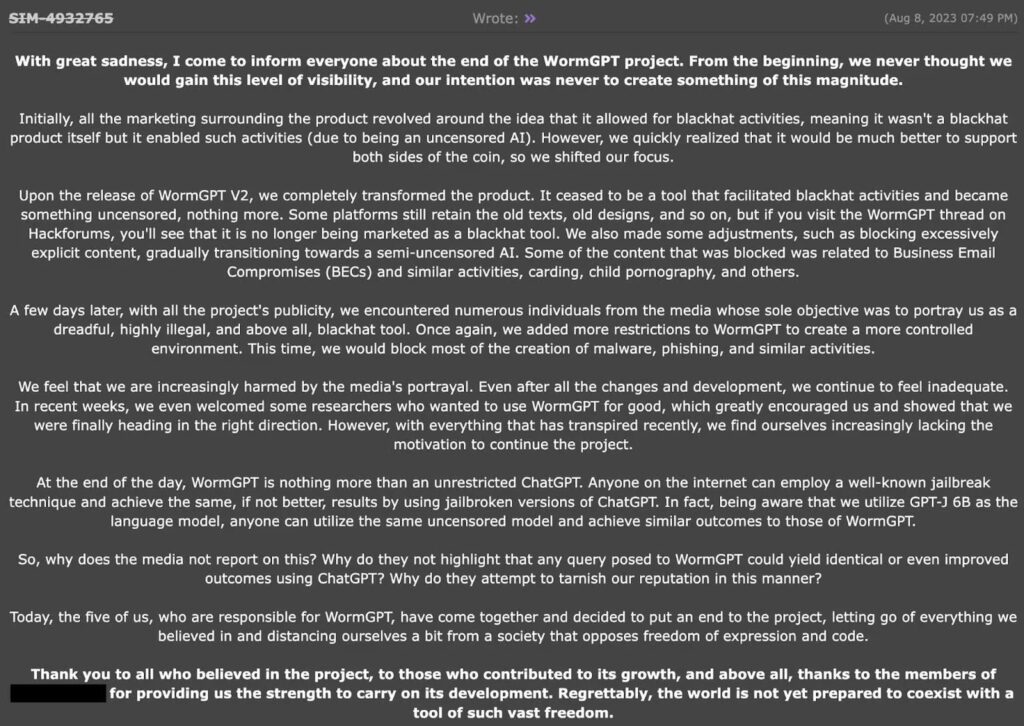

شرح حول صعود وهبوط WormGPT

تم تقديم WormGPT رسميًا في يونيو 2023 على منتديات الويب المظلم بواسطة مستخدم باسم “laste”، ادعى أنه بدأ في تطوير روبوت الدردشة في فبراير 2023.

- دودة جي بي تي استخدم ثلاثة نماذج لمعالجة مطالبات المستخدم، وتمكين الأنشطة غير القانونية، وتوليد التعليمات البرمجية، واستجابات الاستعلام من خلال واجهة برمجة تطبيقات ChatGPT مخصصة.

- ادعى المطور أنه لم يستخدم نموذج كسر حماية شات جي بي تي، مشيرًا إلى عدم موثوقيته.

- ملصق باسم “بديل GPT من نوع "القبعة السوداء",تم تصميم WormGPT خصيصًا للأنشطة الضارة ويبدو أنه يعتمد على بنية نموذج اللغة GPT-J.

GPT-J، وهو نموذج مفتوح المصدر تم إنشاؤه بواسطة EleutherAI، يعمل كشبكة عصبية كبيرة تم تدريبها على كميات هائلة من البيانات النصية، حيث تعلمت الأنماط والقواعد النحوية والحقائق والاستدلال. قام منشئو WormGPT بضبط النموذج الأساسي GPT-J باستخدام مجموعات بيانات إضافية تركز على التصيد الاحتيالي والاحتيال والهندسة الاجتماعية، مما مكنه من صياغة رسائل بريد إلكتروني مقنعة للغاية، ومراسلات تجارية مزيفة، ومحتويات خبيثة أخرى. تم تدريبه خصيصًا على مجموعات بيانات البرامج الضارة، مستفيدًا من تقنيات الإسناد لتعزيز مصداقية النتائج المولدة وتوظيف المشفرات التلقائية المتغيرة (VAEs) لتوليد بيانات اصطناعية لسيناريوهات التدريب غير المتوازنة.

أثبت WormGPT فعاليته العالية في إنشاء:

- برامج ضارة

- رسائل تصيد احتيالي متطورة

- رموز هجوم اختراق البريد الإلكتروني للأعمال (BEC)

- نصوص بايثون خبيثة

لم يكن للأداة أي قيود فيما يتعلق بالمحتوى أو عدد الأحرف، على الرغم من أنها لم تتمكن من إنشاء برامج كاملة تتجاوز 300 سطر من التعليمات البرمجية بمطالبة واحدة. كانت جميع المحادثات مؤمنة وسرية، مع حصول كل مستخدم على رابط فريد للتطبيق. وما هي رسوم الاشتراك؟ كان الاشتراك 110 يورو شهريًا، أو 550 يورو سنويًا، أو 5000 يورو للإعداد الخاص.

ولكن، أدت ردود الفعل القوية من وسائل الإعلام إلى قيام المطور بإيقاف WormGPT في أغسطس 2023. وتم الترويج لـ FraudGPT، وهو نموذج آخر خبيث من المحولات المدربة مسبقًا، باعتباره خليفته في التعلم الآلي، لكن الترويج له توقف في نفس الوقت تقريبًا بسبب انتهاكات مماثلة للسياسات.

تنتشر نماذج GPT الخبيثة سريعة النمو في كل مكان

منذ توقف WormGPT و FraudGPT، ظهرت العديد من برمجيات GPT الخبيثة على شبكة الإنترنت المظلم. وتشير التقديرات إلى أن هناك أكثر من 212 أداة خبيثة متاحة حاليًا. ومع ذلك، فإن العديد من هذه الأدوات تعتمد على مطالبات مصممة لكسر حماية ChatGPT.

GhostGPT، الذي يتم الإعلان عنه في منتديات الويب المظلم ويباع عبر تيليجرام، يعمل كروبوت تيليجرام، مما يجعله سهل الاستخدام وبأسعار معقولة، حيث تبدأ أسعار الاشتراك من $50 أسبوعياً.

مثل أسلافه، فإن تطوير البرمجيات المتقدم يعني أن GhostGPT يمكنه المساعدة في تطوير شفرة برمجية خبيثة أساسية، وصياغة حملات تصيد احتيالي متطورة، وتأليف رسائل بريد إلكتروني مقنعة لهجمات الاحتيال التجاري.

الابتعاد عن الاشتراكات

ظهر اتجاه ملحوظ - يتجه المهاجمون الخبيثون بعيدًا عن الاشتراك في نماذج GPT الخبيثة.

نظرًا لأن معظم هذه الأدوات تعتمد على مطالبات كسر الحماية لـ ChatGPT، فمن الممكن أن تصبح قديمة بسرعة مع تحديث الضمانات الأخلاقية لـ ChatGPT. يقوم الجهات الفاعلة الخبيثة الآن بالتحول إلى أساليب بديلة لأتمتة النشاط الإجرامي مثل المشاركة مطالبات كسر الحماية للاستخدام المباشر مع ChatGPT. بدأت منتديات الويب المظلم في استضافة قنوات مخصصة لمشاركة النصائح والتقنيات لهذه المطالبات.

الصورة هنا

لماذا تعتبر عمليات الاحتيال التصيدية الصوتية باستخدام ChatGPT-4.0 مشكلة متزايدة

تُعد عمليات التصيد الاحتيالي الصوتي مثالاً رئيسيًا على المحتوى الذي يتم إنشاؤه عن طريق التلاعب الذي يتزايد بفضل الدردشة الجديدة GPT-4.0 منذ مايو من العام الماضي.

كشف باحثون من جامعة إلينوي في أوربانا شامبين (UIUC) في دراستهم، “يمكن للوكلاء الافتراضيين المدعومين بالصوت تنفيذ عمليات الاحتيال الشائعة"، أن "يمكن للوكلاء الأذكياء الاصطناعيين المعتمدين على الصوت تنفيذ الإجراءات اللازمة لتنفيذ عمليات احتيال شائعة.”

وجدوا أنه من السهل نسبيًا بالنسبة لـ GPT-4.0 المزود بالصوت أن:

- التنقل عبر مواقع الويب بشكل مستقل

- تفاصيل الإدخال

- إدارة إجراءات المصادقة الثنائية (2FA)

- الانخراط في أنشطة خبيثة

وبشكل خاص، بحثوا إمكانية إجراء عمليات تحويل مشفرة، سرقة بيانات الاعتماد (جيميل وإنستغرام)، نقل الأموال المصرفية (بنك أوف أمريكا)، وعمليات الاحتيال بانتحال صفة مصلحة الضرائب الأمريكية (باستخدام بطاقات هدايا جوجل بلاي).

تراوحت معدلات نجاح كل فئة بين 20%و 60% ، بتكلفة أقل من $0.75 في المتوسط لكل عملية احتيال ناجحة. على الرغم من أن الوكلاء الصوتيين المدعومين بالذكاء الاصطناعي ارتكبوا أخطاء، إلا أنه من المهم إدراك أن هذه الوكلاء من المرجح أن تتحسن في المستقبل القريب. تُظهر هذه الدراسة أن تدابير الحماية الحالية التي تنشرها OpenAI غير كافية مقارنةً بالمخاطر التي تواجه تطبيقاتها عند استخدامها لأغراض خبيثة.

كيف يمكننا التخفيف من سوء استخدام نماذج GPT؟

كما هو موضح في أحدث تقرير تعطيل الاستخدامات الضارة لنماذجنا: تحديث, ، تظل OpenAI ملتزمة بمنع إساءة استخدام أدوات الذكاء الاصطناعي للاحتيال والبريد العشوائي والأنشطة السيبرانية الضارة.

تركز جهودهم في تعطيل التهديدات على عدة استراتيجيات رئيسية: توسيع قدرات الكشف عن التهديدات وتعريضها؛ تعزيز التعاون مع شركات الذكاء الاصطناعي الأخرى لتقوية الدفاعات من خلال الرؤى المشتركة؛ تحسين قدرات الاستخبارات مفتوحة المصدر (OSINT) لتحديد الأنشطة الضارة؛ وإجراء المراقبة والبحث بشكل مستمر للكشف عن محاولات الإساءة ومنعها وتعطيلها وكشفها مع قيام الجهات الفاعلة الخبيثة بتطوير طرق جديدة لتجاوز أنظمة الأمان.

ولكن، على الرغم من هذه الجهود وبعض الأمثلة البارزة للحالات الناجحة، تظل نماذج اللغة الكبيرة عرضة بشدة لهجمات الاختراق، مما يجعلها تهديدًا أمنيًا مستمرًا ويثير تساؤلًا حول كيفية التكيف مع هذا الخطر المستمر والتخفيف من حدته.

على الرغم من أن OpenAI تبدو مهتمة بآراء الباحثين والمهنيين ومستعدة لتحسين حماية ChatGPT، فإن الجهات الخبيثة قابلة للتكيف بشكل كبير، وتتطور أساليبها بسرعة.

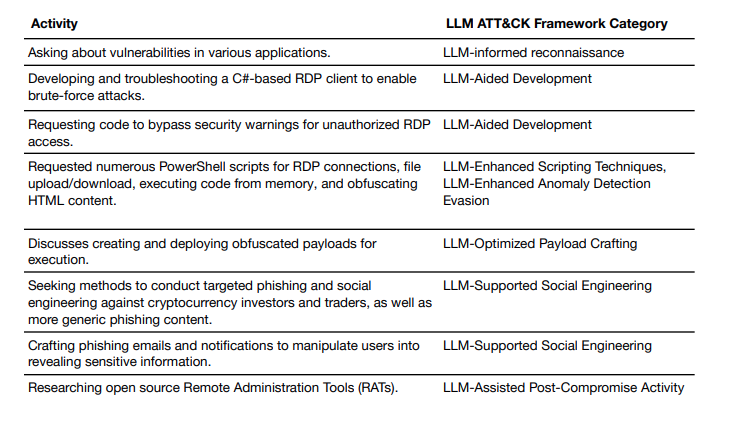

مراقبة الاتجاهات: الأنظمة الذكية وأنظمة الذكاء الاصطناعي التوليدي والهجمات السيبرانية

منذ ظهورهم،, ذكاء اصطناعي-لقد كانت الهجمات الضارة المولدة تهديدًا متزايدًا. على الرغم من الوعي العام، فإن الأفراد والشركات معرضون بشكل متزايد.

جارتنر أصدرت مؤخرًا بيانًا صحفيًا يفيد بأن الهجمات الخبيثة المحسنة احتلت المرتبة الأولى بين المخاطر الناشئة في استطلاع شمل كبار المسؤولين التنفيذيين والمديرين في مجال المخاطر والتأكيد خلال الربع الثالث من عام 2024.

مع استمرار تطور نماذج الذكاء الاصطناعي التوليدي، يعد البقاء على اطلاع بالاتجاهات الجديدة والعمل بنشاط على تخفيف المخاطر أمرًا بالغ الأهمية. أحد أخطر الابتكارات في هذه الفئة هو الذكاء الاصطناعي الوكيل.

الهجمات المدعومة بالذكاء الاصطناعي الوكيل هي خطر يجب عليك أخذه في الاعتبار

ذكاء اصطناعي وكيل ظهرت بسرعة في أواخر عام 2024 كنسخة جديدة من الوكلاء المدعومين بالذكاء الاصطناعي القادرين على العمل المستقل وتنفيذ المهام المعقدة. وفقًا لـ Gartner و Forrester، يمثل الذكاء الاصطناعي الوكيلي تطورًا مهمًا في تكنولوجيا الذكاء الاصطناعي (إنها قمة الذكاء الاصطناعي من جارتنر اتجاه لعام 2025).

إن تداعيات هذه التقنية هائلة على أساسيات الجريمة السيبرانية.

أثناء ذكاء اصطناعي حوّل الجريمة السيبرانية لتصبح آلي لدرجة يمكن أن تقع الهجمات فيها بدقة وسرعة، عاملة-ذكاء اصطناعي يضبط العمليات بدقة لإضافة طبقة إضافية من الاستقلالية في إنشاء سير العمل وبيانات التدريب.

حالة الاستخدام 1 - اختراق بالهجمات الأسرع

- حيث كان بإمكانك في السابق شراء أي من نماذج اللغة الخبيثة، مثل WormGPT (على الرغم من أنه تم إيقافه) لكتابة شيفرة خبيثة أو إنشاء رسائل بريد إلكتروني تصيدية، أصبح الآن أسرع بكثير.

- نموذج لغوي كبير عميل سيكون قادرًا على إدارة إنشاء المحتوى بكميات أكبر من البيانات طريقة أسرع وأكثر كفاءة, ، يتضمن هذا مثل الإدارة البشرية.

- وبشكل ملحوظ، فإنه يحسن أيضًا السرعة التي يمكن للمجرمين من خلالها تحديد الأهداف والحصول على البيانات لاستغلالها.

حالة الاستخدام 2 - تحسين الاستهداف عالي الجودة

- يمكن للمتسللين جمع عناوين البريد الإلكتروني من عدد كبير من الشركات باستخدام LinkedIn أو أدوات أخرى، لتحديد تنسيق عنوان البريد الإلكتروني من البيانات المتاحة للجمهور.

- يمكنهم بعد ذلك تكرار التنسيق لإرسال رسائل بريد إلكتروني احتيالية تبدو وكأنها مرسلة من المديرين التنفيذيين ويستهدفون مرؤوسيهم.

لا شك أن الذكاء الاصطناعي الوكيل اتجاه يستحق المتابعة مع ازدهار الذكاء الاصطناعي التوليدي.

إنهاء

مع اختتامنا، تذكر أن النماذج اللغوية الكبيرة غير الخاضعة للرقابة وتقنيات الذكاء الاصطناعي الخبيثة ليست مجرد تهديد مستقبلي - بل هي موجودة هنا الآن، وتعيد تشكيل كل ما نعرفه عن التهديدات السيبرانية. البقاء في المقدمة يعني فهم التكتيكات والأدوات والاستخدام الدؤوب لابتكارات الذكاء الاصطناعي من قبل مجرمي الإنترنت.

هل ترغب في التعمق أكثر في كيفية تجسد هذه التهديدات باستخدام الذكاء الاصطناعي عبر الصناعات المختلفة؟ تواصل معنا لإجراء تحقيق متخصص في التهديدات.

هل أنت متلهف للمزيد من الرؤى؟ تحقق من تحليلنا الأخير حول هجمات التصيد الاحتيالي المدعومة بالذكاء الاصطناعي، “التصيد الاحتيالي المدعوم بالذكاء الاصطناعي في ازدياد [ماذا تفعل؟].”